Amazon Web Services ブログ

Category: Generative AI

Failure Analysis Assistant – AIOps で障害分析を効率化してみよう –

システムやサービスを提供する上で、障害はつきものです。障害を迅速に分析し対処することがユーザビリティやサービス […]

生成 AI で加速する e コマースの変革 その 2 – AWS Summit Japan 2024 で展示した Amazon Bedrock デモの解説

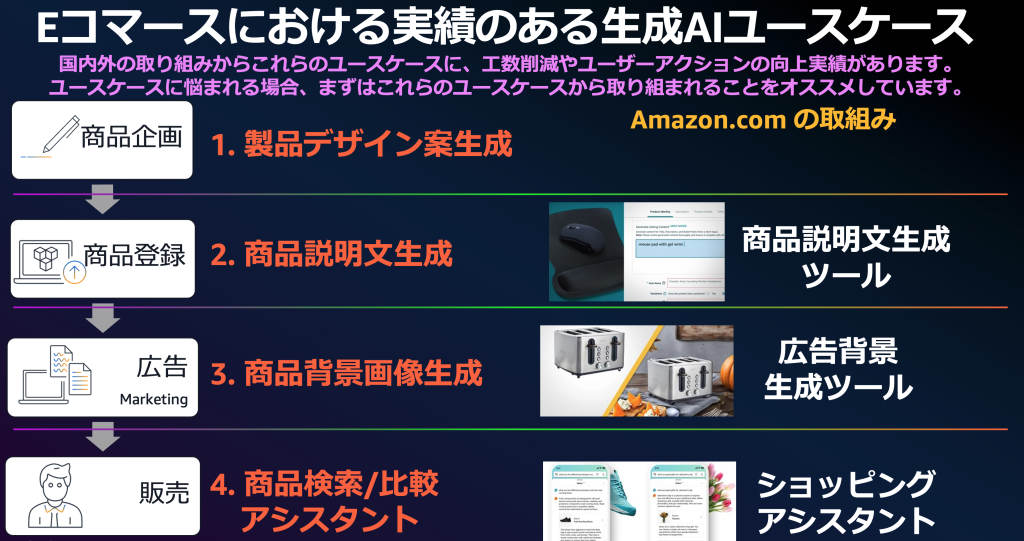

AWS では e コマース(以下 EC)業界におけるユースケースの整理とその実装を支援しております。

本ブログでは以下 2回に分けて、EC業界における生成AI活用ユースケースについて解説をしていきます。

その 1:EC 業界における課題と生成 AI ユースケースによる解決案の整理

その 2:それらユースケースの実装例として AWS Summit Japan 2024 で展示したデモの解説

今回はその 2、EC 業界における代表的な生成 AI ユースケースについて、Amazon Bedrock を利用した具体的な実装例として AWS Summit Japan 2024 で展示したデモの解説を行います。

生成 AI で加速する e コマースの変革 その 1 – EC 業界における 4 大ユースケース紹介

AWS では e コマース(以下 EC)業界におけるユースケースの整理とその実装を支援しております。

本ブログでは以下 2回に分けて、EC業界における生成AI活用ユースケースについて解説をしていきます。

その 1:EC 業界における課題と生成 AI ユースケースによる解決案の整理

その 2:それらユースケースの実装例として AWS Summit Japan 2024 で展示したデモの解説

今回はその 1、EC 業界における代表的な生成 AI ユースケースが解決する業界課題について、背景から解説していきます。

AWS Summit Japan 2024 ヘルスケア・ライフサイエンス 展示ブース 開催報告

国内最大規模の学習型ITカンファレンスである AWS Summit Japan が、6 月 20 日(木)、2 […]

AWS Trainium、AWS Inferentia が AWS 上の Llama 3.1 モデルに高性能と低コストを提供

本日、AWS Trainium と AWS Inferentia による Llama 3.1 モデルのファインチューニングと推論のサポートを発表できることを嬉しく思います。Llama 3.1 ファミリーは、8B(80億)、70B(700億)、405B(4,050億)サイズの事前学習およびインストラクションチューニング済みの多言語大規模言語モデル(LLM)のコレクションです。

以前の投稿では、Amazon SageMaker JumpStart で AWS Trainium と Inferentia ベースのインスタンスに Llama 3 モデルをデプロイする方法について解説しました。今回の投稿では、AWS AI チップ上で そのコストパフォーマンスの利点と共に Llama 3.1 ファミリーのモデルのファインチューニング及びデプロイを実現する方法について概説します。

【開催報告】生成AI ユースケース創出 Boot Camp in 大阪

西日本で製造業のお客様を支援しているソリューションアーキテクトの澤、池田、森です。 2024年 6月 27日に […]

【開催報告】 オンライン化によって進化する次世代自販機のご紹介

2024 年 6 月 20 日、21 日に開催された AWS Summit Japan の展示から、「新価格体験を実現する次世代自販機」をご紹介します。この展示では、消費財企業にとって重要な Direct to Consumer の販売チャンネルである自販機をオンライン化することによって進化させて、在庫や周囲環境の状況に合わせて販売価格を最適化するダイナミックプライシングのアイデアを紹介しました。

AWS Supply Chain は ESG データコンプライアンスを簡素化します

組織は、広大なグローバルサプライチェーンを横断してサステナビリティコンプライアンスを維持するという複雑な課題に […]

開催直前!AWS Builders Online Series の歩き方 – 「生成 AI 実践入門」のご紹介 #AWSBuilders

Hello Builders の皆様もしくは Builders の卵の皆様、こんにちは!機械学習ソリューション […]

スキャンしたPDFをAmazon Q Businessで利用し、生産性を向上させる

Amazon Q Business は、生成 AI 対話アシスタントであり、企業のデータソースに格納されたデジタルコンテンツだけでなくスキャンした PDF からも、事前のテキスト抽出をせずとも直接質問に答えたり、要約を作成したり、コンテンツを生成したり、インサイトを発見することが可能になりました。本記事では、Amazon Q Business を使用し、スキャンした PDF ドキュメントを非同期でインデックス化、リアルタイムでクエリを実行する方法を説明します。